In meinem Atelier möchten wir einen realistisch aussehenden menschlichen 3D Charakter erstellen.

Wir bieten Ihnen 3D Charakterdesign nach Ihrem Ebenbild in unserem Atelier in Hagen an. Wir benötigen nur wenige Fotos von Ihnen und nach wenigen Tagen erhalten Sie Ihr zweites Ich in 3D.

Mit dieser Artikelserie möchten wir Ihnen zeigen, wie wir arbeiten.

Sie haben es eilig? Dann speichern Sie diesen Blogartikel von R23 als PDF

Brauchen Sie den Inhalt dieses Artikels “3D Charakterdesign: Claudia bekommt ein neues Rig” schnell und bequem? Dann speichern Sie ihn doch einfach als PDF!

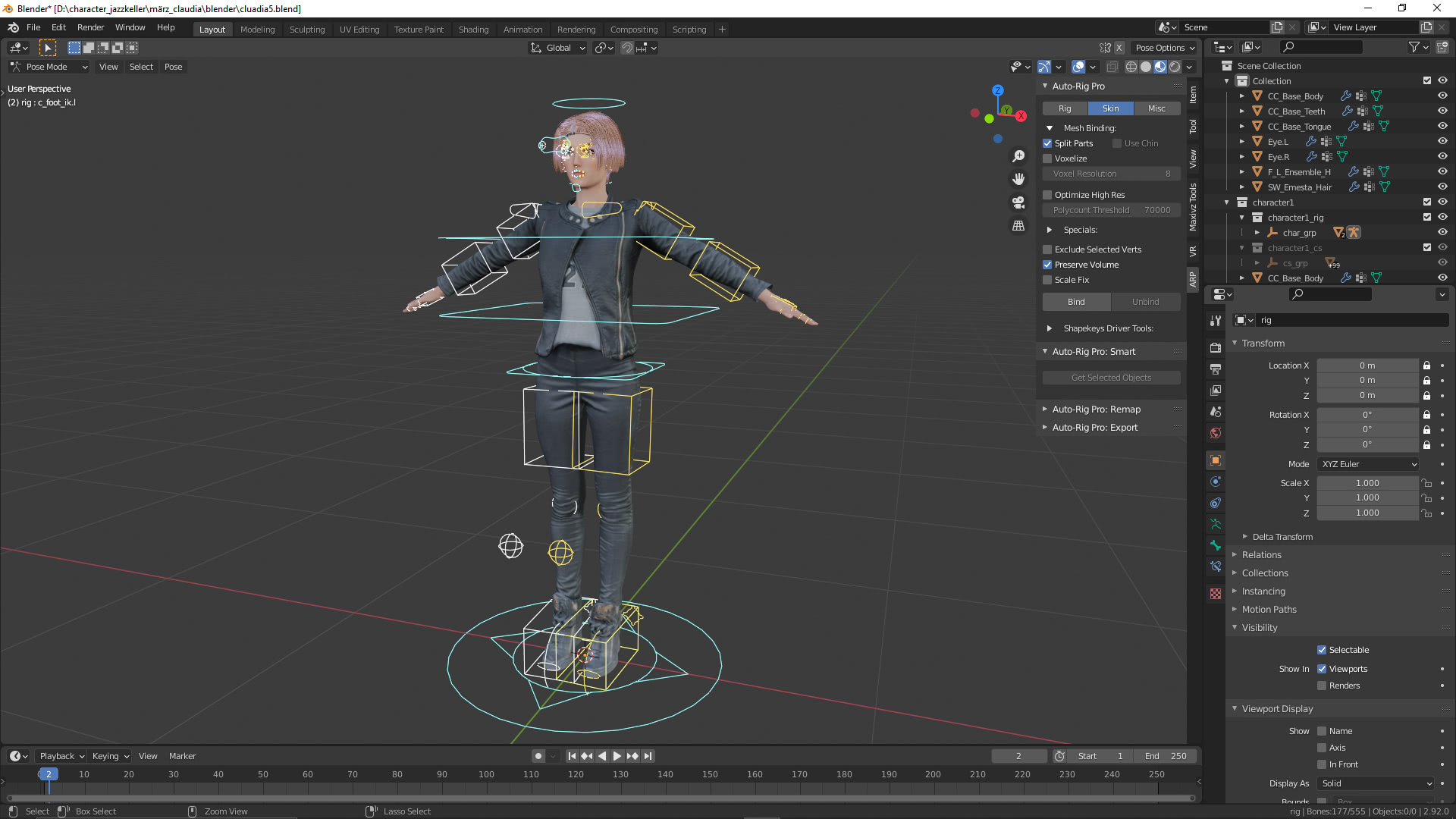

In den letzten r23 Artikeln bekam der 3D-Charakter eine neue Frisur, dann neue Kleidung. Sie tanzte Samba für uns und wir haben die Qualität weiter verbessert. Vor diesem Hintergrund sind wir zurück beim Rigging.

Was ist Rigging?

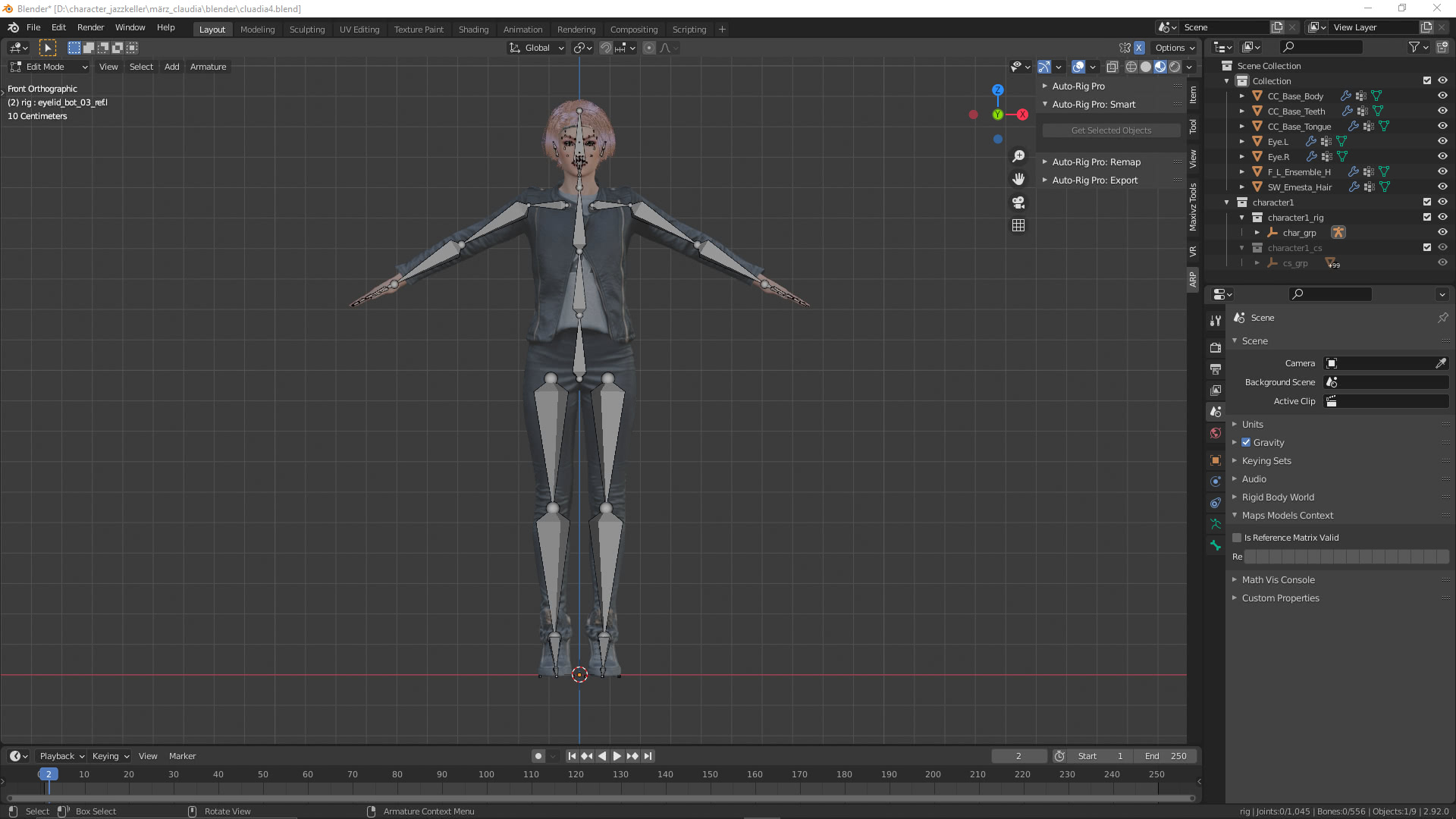

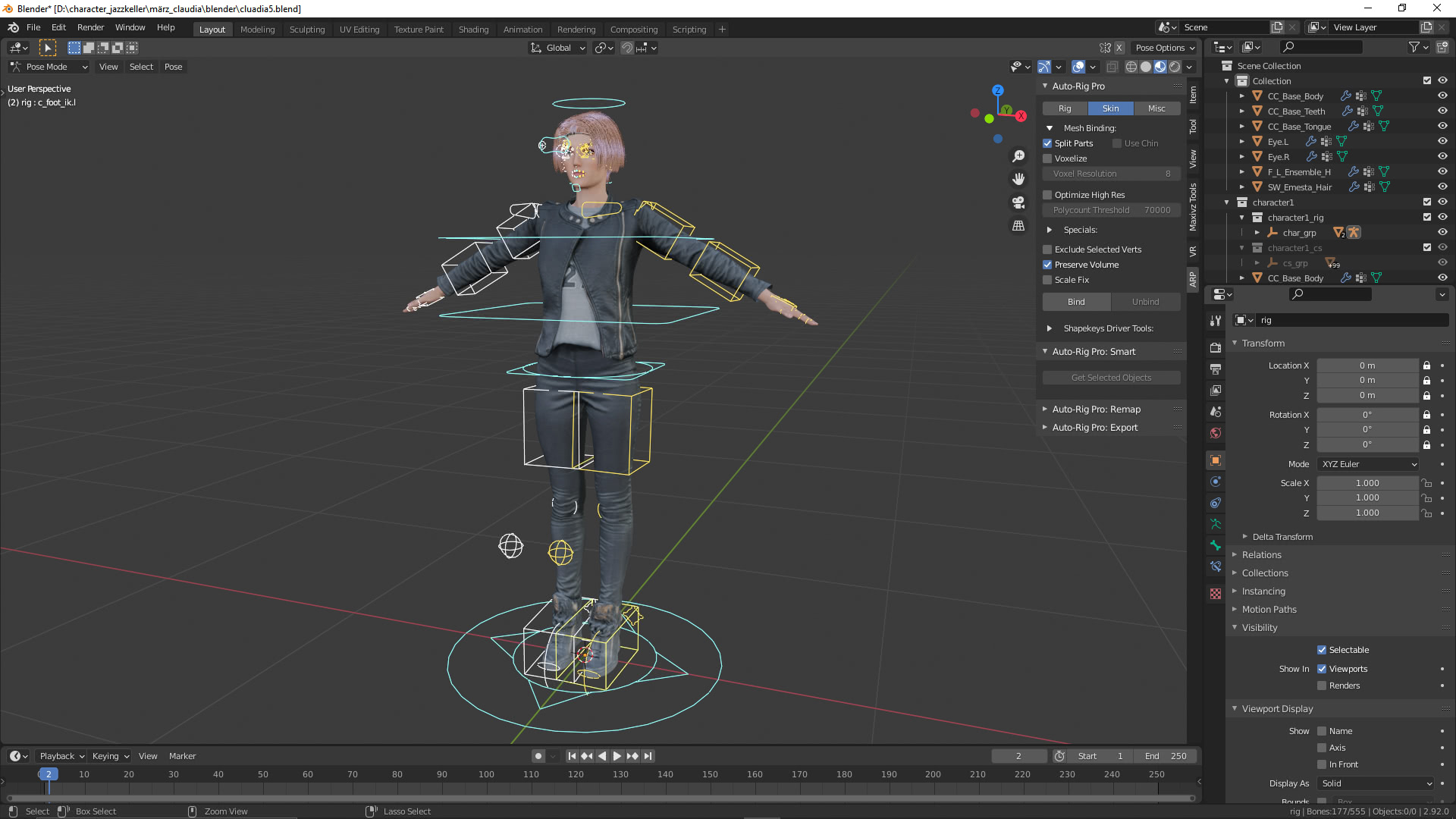

Beim Rigging kekommt der 3D-Charakter ein sogenanntes Skelett bzw. Rig aus Bones (Knochen) oder auch Joints (Gelenken) konstruiert, das festlegt, wie die einzelnen Teile eines Meshes bewegt werden können.

Mesh Reduzierung

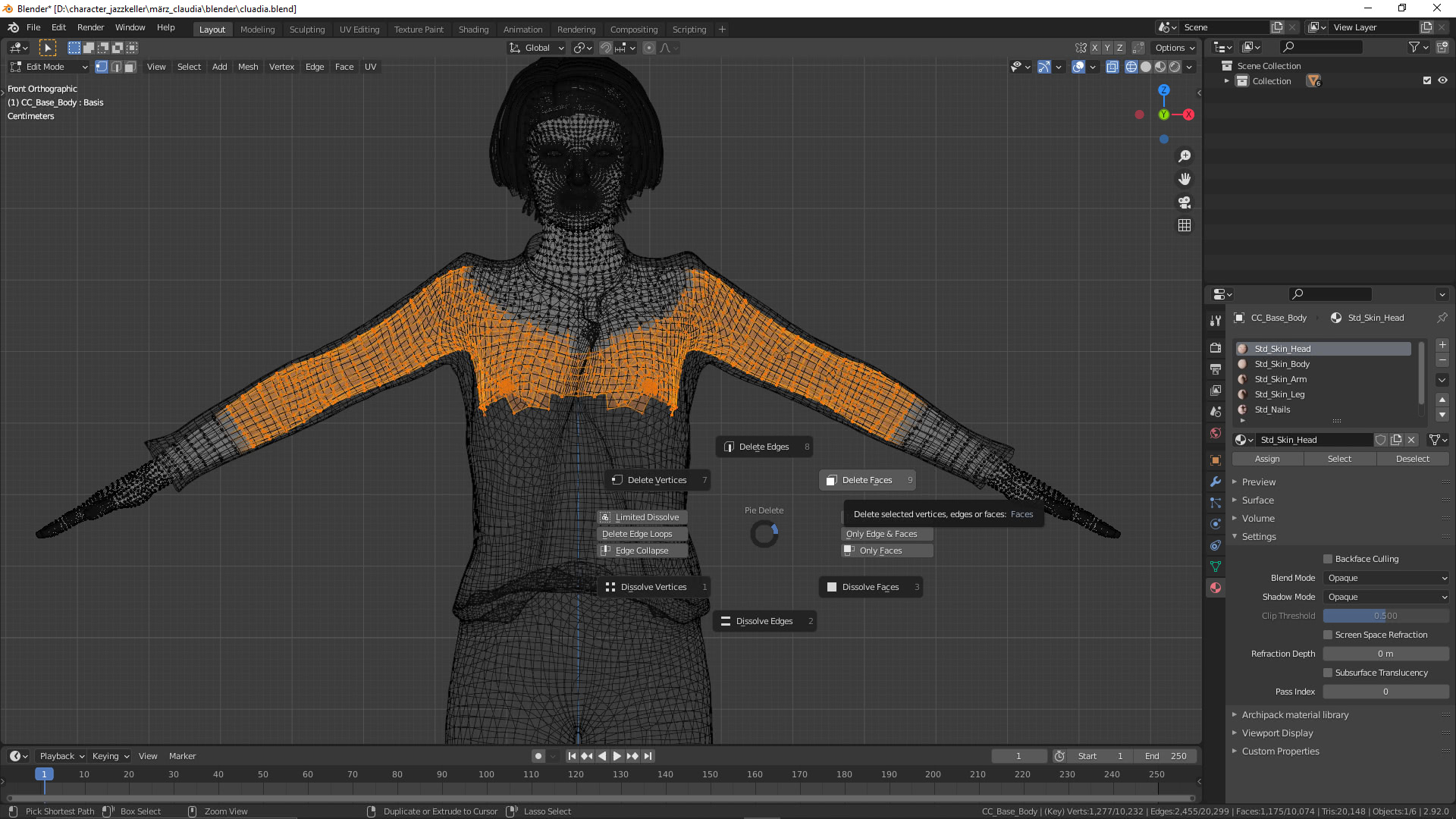

Für eine bessere Optimierung sind die nicht sichtbaren Flächen nicht nötig.

Im ersten Schritt werden diese Flächen gelöscht.

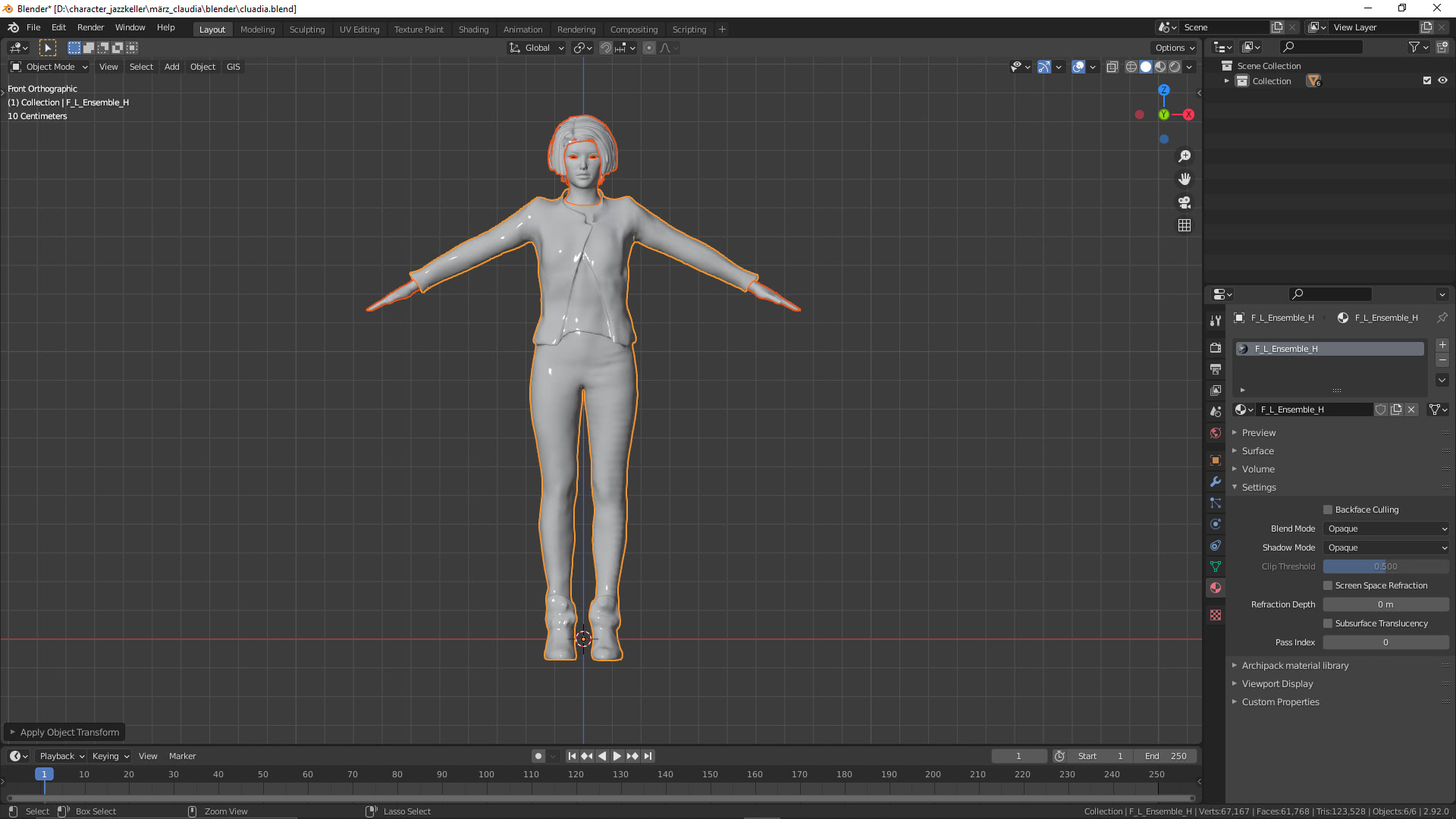

Claudia in T – Pose

Claudia nach der Entfernung des alten Riggs in A – Pose.

Die nicht sichtbaren Flächenwerden gelöscht.

Augen

Die Augen sollen sich später bewegen können.

Wie geht es weiter?

Die Zunge und die Lippen sollen sich später auch bewegen können. Für die berufliche Weiterbildung verwenden wir Udemy. Hier haben wir weitere Online Kurse gebucht, und hoffen, dass wir noch besser werden.

Wo ist das Cookie Banner?

Wir haben keins! Weil wir nicht tracken, und auch keine unnötigen Cookies setzen. Menschen sollten nicht akzeptieren müssen, im gesamten Web getrackt zu werden.

Jetzt sind Sie gefragt!

Haben Sie Anregungen, Ergänzungen, einen Fehler gefunden oder ist dieser Beitrag nicht mehr aktuell? Dann freuen wir uns auf Ihren Kommentar.

Sie können diesen Beitrag natürlich auch weiterempfehlen. Wir sind Ihnen für jede Unterstützung dankbar!

Schreiben Sie einen Kommentar